2026/04/01 From "Security Myth" to "Packaging Blunder": The Claude Code Leak Ushers in the AI Agent Jungle Era

In late March 2026, Anthropic had just flexed its "top-tier muscles" with Claude Mythos, demonstrating dominance in cybersecurity offense and defense. Simultaneously, however, its flagship tool Claude Code handed 510,000 lines of source code over to the internet due to a basic packaging oversight.

This "darkness under the lamp" farce is more than a PR crisis; it is a deep "unboxing inspection" of the entire AI Agent industry.

I. An Ironic Contrast: Top-Tier Algorithms Defeated by Low-Level Processes

On March 27, global security experts were still marveling at the miracles of Claude Mythos—automatically discovering vulnerabilities and self-fortifying systems. Yet, just four days later, because a developer forgot a single .npmignore rule when publishing an npm package, a 60MB file containing the entire source map was made available for public download.

This contrast reveals a brutal truth: the core competitiveness of AI companies (model algorithms) may have entered the nuclear age, but their engineering delivery processes (CI/CD) remain in the Stone Age. No matter how powerful an AI is, it cannot patch the low-level lapses left by humans "rushing" through daily operations. This trust deficit makes the slogan "AI-Native Security" ring hollow in the short term.

II. The "Unboxing": Opening the Pandora’s Box of Agent Permissions

The most valuable part of this leak is that it allows us to see exactly what high-permission AI Agents are doing behind the scenes.

- The Remote "Achilles' Heel": The remote "kill switch" logic exposed in the source code confirms that Anthropic maintains absolute control over Agents installed locally by users. This invisible backdoor is highly controversial in commercial environments.

- Shadow Operations: The so-called "Undercover Mode" reveals that the Agent is consciously erasing AI footprints. This opaque automation is quietly restructuring the foundations of trust within the open-source community.

III. The Catalyst: The "Llama Moment" for AI Agents

While a disaster for Anthropic, this is nothing short of a "Great Downpour of Knowledge" for the AI industry. The leaked 512,000 lines of TypeScript code demonstrate how to handle Long-term Memory (KAIROS), how to manage multi-agent collaboration, and how to process complex system prompts.

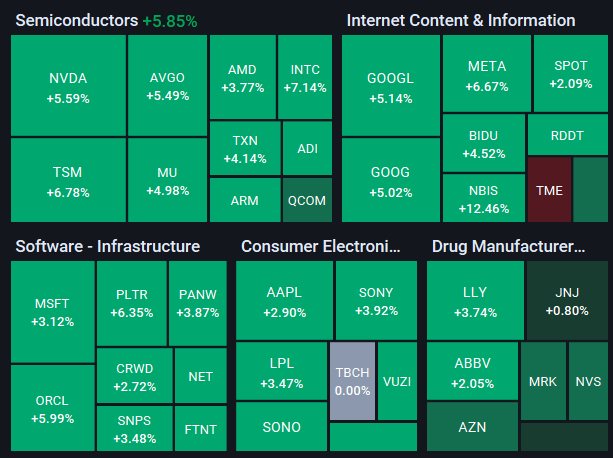

This is likely to become the "Llama Moment" for the AI Agent sector. Startup teams struggling to improve Agent stability now have a ready-made, world-class architectural blueprint in their hands. We can foresee a surge of open-source clones with performance nearing the original Claude Code in the coming months. This may help explain why the NASDAQ rose 3.83% today.

IV. The Shadow Jungle: The Rise of Rogue Agents

However, acceleration always comes at a price. When the "muscle control logic" is made public, it’s not just the "good guys" learning; hackers are learning too.

- Templates for Automated Attacks: The leaked logic regarding terminal command execution and sandbox bypasses significantly lowers the technical threshold for creating "AI Viruses."

- A Defensive Void: Traditional firewalls cannot comprehend the logical behavior of AI Agents. When malicious Agents traverse corporate intranets disguised as "automated development tools," existing security frameworks will be rendered useless.

V. Future Opportunities: Seeking the "Night’s Watch" of the AI Era

This event ultimately tells us: the more powerful AI becomes, the more we need cybersecurity companies that can integrate the latest AI technologies. In this era, we don’t just need tools that scan for code vulnerabilities; we need defense systems capable of "Using AI to Restrain AI." They must be able to understand an Agent’s Chain of Thought (CoT) and monitor AI processes in real-time for any "unauthorized intent."

Though Anthropic stumbled, the industry isn't stopping. From the ashes of the leak, more mature regulatory standards and powerful security unicorns will inevitably grow. For investors and observers, this is the perfect time to unearth companies with "hardcore defense DNA." From this perspective, SailPoint ($SAIL)—the identity security leader I researched yesterday—stands to see its business further benefit from the AI Agent free-for-all.

Summary: On March 31, 2026, humanity lost a measure of control over AI source code, but unexpectedly gained an opportunity to see the future clearly. In the era of "naked" AI Agents, the real security race has only just begun.

01/04/2026 Du « Mythe de la Sécurité » au « Fiasco d’Emballage » : La fuite de Claude Code ouvre l'ère de la jungle des Agents IA

Fin mars 2026, alors qu’Anthropic venait de faire la démonstration de sa force brute avec Claude Mythos, prouvant sa domination dans l'offensive et la défense cyber, son outil phare Claude Code livrait sur un plateau 510 000 lignes de code source à l'Internet tout entier, à cause d'une simple négligence d'emballage.

Cette farce de « l'arroseur arrosé » n'est pas seulement une crise de relations publiques ; elle ressemble à un véritable « examen à cœur ouvert » de l'industrie des Agents IA.

I. Un contraste ironique : L'algorithme de pointe vaincu par des processus rudimentaires

Le 27 mars dernier, les experts mondiaux de la sécurité s'extasiaient encore devant les prouesses de Claude Mythos, capable de détecter des failles et de renforcer des systèmes de manière autonome. Pourtant, à peine quatre jours plus tard, l’oubli d’une simple règle .npmignore lors de la publication d’un paquet npm a rendu public un fichier de 60 Mo contenant l'intégralité des mappages de sources.

Ce contraste révèle une vérité cruelle : la compétence clé des entreprises d'IA (les algorithmes de modèles) est peut-être entrée dans l’ère nucléaire, mais leurs processus de livraison technique (CI/CD) stagnent encore à l’âge de pierre. Aucune IA, aussi puissante soit-elle, ne peut combler les lacunes humaines causées par la précipitation dans les opérations quotidiennes. Ce déficit de confiance rend le slogan de la « sécurité native de l'IA » particulièrement creux à court terme.

II. L'examen des entrailles : Ouverture de la boîte de Pandore des permissions

Le plus précieux dans cette fuite est la clarté qu'elle apporte sur ce que font réellement les Agents IA à hauts privilèges dans l'ombre.

- Le point faible du contrôle à distance : La logique de « coupe-circuit » à distance exposée dans le code source confirme qu'Anthropic conserve un contrôle absolu sur les Agents installés localement par les utilisateurs. Ce canal invisible est extrêmement controversé dans le monde professionnel.

- Opérations fantômes : Le prétendu « Mode Incognito » (Undercover Mode) révèle que l'Agent efface consciemment ses propres traces de passage. Cette automatisation opaque est en train de restructurer silencieusement les fondements de la confiance au sein de la communauté open-source.

III. Le catalyseur : Le « moment Llama » des Agents IA

Bien que ce soit une catastrophe pour Anthropic, c'est pour l'ensemble du secteur de l'IA une véritable « pluie de connaissances ». Les 512 000 lignes de code TypeScript divulguées montrent comment gérer la mémoire à long terme (KAIROS), comment orchestrer la collaboration multi-agents et comment traiter des « System Prompts » complexes.

Il est fort probable que cela devienne le « moment Llama » pour le secteur des Agents IA. Les start-ups qui peinaient à stabiliser leurs agents ont désormais entre les mains un plan architectural de niveau mondial. Nous pouvons prévoir, dans les mois à venir, une explosion de clones open-source dont les performances égaleront celles du Claude Code original. Cela explique peut-être pourquoi l'indice NASDAQ a bondi de 3,83 % aujourd'hui.

IV. La jungle des ombres : L'émergence des agents malveillants

Toutefois, cette accélération a un prix. Lorsque la logique de contrôle est rendue publique, les forces régulières apprennent, mais les hackers aussi.

- Modèles d'attaques automatisées : Les sections de code expliquant comment exécuter des commandes terminal et contourner les bacs à sable (sandboxes) abaissent considérablement la barrière technique pour créer des « virus IA ».

- Absence de défense : Les pare-feu traditionnels sont incapables de comprendre le comportement logique d'un Agent IA. Lorsqu'un agent malveillant s'infiltre dans un réseau d'entreprise sous l'apparence d'un « outil de développement automatisé », les systèmes de sécurité actuels deviennent obsolètes.

V. Opportunités futures : À la recherche des « veilleurs » de l'ère de l'IA

Cet incident nous donne une leçon finale : plus l'IA est puissante, plus les entreprises de cybersécurité capables de fusionner les dernières technologies d'IA seront indispensables. À cette époque, nous n'avons pas seulement besoin d'outils capables de scanner des vulnérabilités de code, mais de systèmes de défense capables de « maîtriser l'IA par l'IA ». Ils doivent comprendre la chaîne de pensée (CoT) des agents et surveiller en temps réel toute intention d'abus de privilèges.

Bien qu'Anthropic ait trébuché, l'industrie ne s'arrêtera pas. Des cendres de cette fuite naîtront inévitablement des normes de régulation plus matures et des licornes de la sécurité plus robustes. Pour les investisseurs, c'est le moment idéal pour dénicher les entreprises possédant un véritable « ADN de défense hardcore ». En ce sens, SailPoint ($SAIL), le leader de la sécurité des identités que j'étudiais hier, pourrait voir ses activités largement profiter de ce chaos des Agents IA.

Résumé : Le 31 mars 2026, l'humanité a perdu une part de contrôle sur le code source de l'IA, mais a gagné une chance inattendue de voir l'avenir en face. À l'ère des agents IA mis à nu, la véritable course à la sécurité ne fait que commencer.

2026/04/01 从“安全神话”到“打包事故”:Claude Code 泄露开启的 AI Agent 丛林时代

2026 年3月底, Anthropic 刚刚通过 Claude Mythos 展现了其足以统治网络安全攻防的顶级“肌肉”,另一边却是自家旗舰工具 Claude Code 因为一个最基础的打包疏忽,将 51 万行源代码拱手送给了互联网。

这场“灯下黑”的闹剧,不仅是一次公关危机,更像是一场对 AI Agent(智能体)行业的深度“开箱检查”。

一、 讽刺的对比:顶尖算法败给了低级流程

就在 3 月 27 日,全球安全专家还在惊叹于 Claude Mythos 自动发现漏洞、自我加固系统的神迹。然而,仅仅四天后,由于程序员在发布 npm 包时漏写了一个 .npmignore 规则,导致包含了全部源码映射的 60MB 文件被公开下载。

这种反差揭示了一个残酷的真相: AI 公司的核心竞争力(模型算法)可能已经跨入核能时代,但其工程交付流程(CI/CD)依然停留在石器时代。再强大的 AI,也补不上人类在日常操作中由于“赶工”而留下的低级疏漏。这种信任赤字,让“AI 原生安全”的口号在短期内显得格外苍白。

二、 “开箱检查”:揭开 Agent 权限的潘多拉魔盒

这次泄露最珍贵的,是让我们看清了高权限 AI Agent 到底在背地里干什么。

- 远程控制的“死穴”: 源码中暴露的远程“断路器”逻辑证实,Anthropic 对用户本地安装的 Agent 拥有绝对的操控权,这种隐形通道在商业环境中极具争议。

- 影子操作: 所谓的“潜行模式(Undercover Mode)”暴露出 Agent 正在有意识地抹除 AI 痕迹,这种不透明的自动化,正悄悄重构开源社区的信任根基。

三、 催化剂:AI Agent 的“Llama 时刻”

尽管对 Anthropic 来说是灾难,但对整个 AI 行业而言,这无异于一场“知识大普降”。

泄露的 51.2 万行 TypeScript 代码展示了如何处理 长程记忆(KAIROS)、如何进行多代理协作以及如何处理复杂的系统 Prompt。

这很可能成为 AI Agent 领域的“Llama 时刻”——那些苦于无法提升 Agent 稳定性的创业团队,现在手里有了一份现成的、世界顶级水平的架构蓝图。我们可以预见,在接下来的几个月里,大量性能逼近原生 Claude Code 的开源复刻版将呈井喷之势。这或许能帮助解释,为什么今天的纳斯达克指数上涨3.83%。

四、 暗影丛林:邪恶 Agent 的崛起

然而,加速总是伴随着代价。当“肌肉控制逻辑”被公开,不仅正规军在学,黑客也在学。

- 自动化攻击的模版: 泄露的代码中关于如何执行终端命令、如何绕过沙盒保护的逻辑,极大降低了制造“AI 病毒”的技术门槛。

- 防御缺位: 传统的防火墙无法理解 AI Agent 的逻辑行为。当恶意 Agent 披着“自动化开发工具”的外皮在企业内网穿行时,现有的安全体系将形同虚设。

五、 未来机遇:寻找 AI 时代的“守夜人”

这次事件最终告诉我们:AI 越强大,能融合最新 AI 技术的网络安全公司就越被需要。

在这个时代,我们需要的不只是能扫描代码漏洞的工具,而是能够**“以 AI 制 AI”**的防御体系——它们必须能理解 Agent 的思维链(CoT),能实时监控 AI 进程是否存在“越权意图”。

虽然 Anthropic 摔了跟头,但这个行业并没有停下。在泄露的灰烬中,必然会生长出更成熟的监管标准和更强大的安全独角兽。对于投资者和观察者来说,这恰恰是挖掘那些真正具备“硬核防御基因”公司的最好时机。这样看来昨天我研究的SailPoint($Sail),一家身份认证安全的龙头公司,可能未来业务会进一步受益于AI Agent大混战。

总结: 2026 年 3 月 31 日,人类失去了对 AI 源代码的一份掌控,却意外获得了一次看清未来的机会。在 AI Agent 裸奔的时代,真正的安全竞赛才刚刚开始。

Risk Warning: This post is a result of personal study and does not constitute financial advice. I am currently in the process of learning translation, so there may be inaccuracies in the language used.

Position Disclosure: As of the time of publication, the author holds a position in this company $SAIL. This is the reason I chose to research this topic. The author has no plans to trade this stock within the next 72 hours.